La teiera di Russell: resoconti dalla fase finale della bolla dell’IA

di Servaas Storm

E se il futuro dell’IA che viene venduto ai mercati si basasse su affermazioni che non reggono a un esame approfondito? Dalla superintelligenza alla perdita di posti di lavoro su larga scala, le promesse più altisonanti sull’IA generativa iniziano ad apparire meno come lungimiranza e più come clamore mascherato da inevitabilità.

E se il futuro dell’IA che viene venduto ai mercati si basasse su affermazioni che non reggono a un esame approfondito? Dalla superintelligenza alla perdita di posti di lavoro su larga scala, le promesse più altisonanti sull’IA generativa iniziano ad apparire meno come lungimiranza e più come clamore mascherato da inevitabilità.

L’attuale comprensione dell’impatto economico dell’IA è errata: l’IA non porterà alla “superintelligenza”, alla distruzione di massa di posti di lavoro, a una disoccupazione tecnologica senza precedenti e a una recessione, né a giganteschi aumenti (aggregati) della produttività del lavoro e a un’accelerazione senza precedenti del progresso tecnologico e della crescita economica. L’impatto a livello aggregato dell’IA sarà piuttosto banale: alcune professioni scompariranno a causa dell’automazione; i lavori esistenti saranno rimodellati dall’IA e nasceranno nuove professioni, mansioni e ruoli per supervisionare e gestire gli strumenti di IA; molti di questi nuovi lavori saranno lavori inutili; tuttavia, la maggior parte delle professioni rimarrà al riparo; la crescita aggregata della produttività del lavoro potrebbe aumentare leggermente (perché gli strumenti di IA potenziano il lavoro), ma allo stesso tempo i costosi danni collaterali dell’IA cresceranno esponenzialmente nel tempo e rallenteranno la crescita della produttività. Maggiore sarà la quantità di scarti generati dall’IA, maggiore sarà il lavoro necessario per ripulire il disordine e maggiore sarà la probabilità che non saremo in grado di vedere l’era dell’IA nelle statistiche sulla produttività. Considerato tutto quanto sopra, l’attuale ciclo di sovrainvestimenti nell’IA non è sostenibile.

* * * *

Le aziende all’avanguardia nel campo dell’Intelligenza Artificiale Generativa (IA) stanno investendo miliardi e miliardi di dollari nello sviluppo, nell’addestramento e nell’esecuzione dei loro algoritmi, presumibilmente alla ricerca di una qualche nozione di “superintelligenza”. Per alimentare l’entusiasmo e tenere incollati allo schermo gli investitori, i loro CEO stanno “inondando il mercato” con una valanga di previsioni non falsificabili, prive di fondamento, che spaziano dalla disoccupazione tecnologica di massa ai timori yudkowskiani di estinzione umana, oppure, in alternativa, a visioni utopiche di una cornucopia di ricchezze, progressi scientifici senza precedenti e una crescita esponenziale della produttività grazie all’automazione onnipresente.

In un nuovo articolo, cerco di esaminare empiricamente le previsioni più importanti, ma anche più assurde, fatte dai CEO della Silicon Valley. Per non impazzire di fronte allo tsunami di pronostici strampalati, mi affido all’analogia della teiera di Bertrand Russell (1952)*. Russell sosteneva che l’onere della prova spetta a chi fa affermazioni non falsificabili, piuttosto che a chi deve confutarle: “Se dovessi affermare che tra la Terra e Marte c’è una teiera di porcellana che ruota attorno al sole su un’orbita ellittica, nessuno sarebbe in grado di confutare la mia affermazione, a patto che io aggiunga che la teiera è troppo piccola per essere rivelata anche dai nostri telescopi più potenti. Ma se poi dicessi che, poiché la mia affermazione non può essere confutata, è un’intollerabile presunzione da parte della ragione umana dubitarne, sarei giustamente considerato un insensato.”

*La teiera di Russell (in inglese Russell’s teapot) o teiera celeste è una metafora introdotta dal filosofo britannico Bertrand Russell per confutare l’idea che spetti allo scettico, anziché a chi le propone, l’onere della prova in merito ad affermazioni non falsificabili, in particolare in ambito religioso. Essa rappresenta una delle più efficaci controargomentazioni all’assunto che spetti al non credente dimostrare l’inesistenza di una qualsiasi divinità, in quanto stabilisce che nessuna affermazione può essere aprioristicamente creduta soltanto basandosi sul fatto che non se ne può provare l’inesattezza. (da Wikipedia)

Non è possibile rendere giustizia alla miriade di previsioni sull’impatto economico dell’IA esaminate nel documento completo. Pertanto, questo articolo valuta brevemente otto previsioni ampiamente dibattute. Spero che ciò convinca i lettori a leggere il documento per le valutazioni più complete. Per chiarezza, l’attenzione è focalizzata sull’IA generativa, rappresentata dal sottoinsieme dei Large Language Models (LLM) commerciali a codice chiuso, e non su strumenti di IA più piccoli e specifici per dominio o approcci alternativi di apprendimento automatico.

Affermazione n. 1: la “superintelligenza” dell’IA è proprio dietro l’angolo

Tutti i CEO del settore tecnologico cantano la stessa canzone, promettendo visioni stravaganti di un’imminente “superintelligenza” che inaugurerà un’era d’oro di abbondanza radicale e progresso scientifico, in cui un’IA generativa super intelligente risolverà e sistemerà i più grandi problemi dell’umanità. È proprio su questa affermazione che si fonda l’intero ciclo di sovrainvestimento nell’IA. Secondo Elon Musk (nel dicembre 2025), l’AGI potrebbe arrivare già nel 2026; Sam Altman di OpenAI concorda; Dario Amodei di Anthropic, Ray Kurzweil di Google e Jensen Huang di Nvidia pensano che ci arriveremo solo intorno al 2029; e Mustafa Suleyman di Microsoft, Eric Schmidt e Sergey Brin di Google prevedono un'”esplosione di intelligenza” intorno al 2030. Non importa se queste previsioni si riveleranno errate: l’Intelligenza Artificiale Generale (AGI) rimane perennemente “dietro l’angolo”.

Avviso della teiera n. 1: l’intelligenza artificiale “superintelligente” non è ancora arrivata. Né è dietro l’angolo

Le previsioni sull’imminente arrivo dell’intelligenza artificiale generale (AGI) evocano una forte sensazione di déjà vu . Molti di noi hanno perso il conto di quante volte i leader della Silicon Valley abbiano promesso l’imminente arrivo di veicoli autonomi, calcolo quantistico, realtà aumentata e robot umanoidi, ed è risaputo che le tempistiche promesse dalla Silicon Valley riflettono le ricorrenti esigenze di raccolta fondi piuttosto che le realtà tecniche. Tuttavia, l’affermazione che l’AGI sia imminente è errata, non per via di tempistiche esagerate, ma piuttosto a livello strutturale, perché l’approccio di scalabilità all’intelligenza artificiale generativa è incapace di generare “intelligenza”, figuriamoci l’AGI.

I modelli linguistici di grandi dimensioni (LLM) non sono intelligenti, non possono ragionare causalmente, non hanno un “modello concettuale del mondo” e non sono senzienti, ma sono piuttosto dei sistemi predittivi di riconoscimento di pattern e potenti macchine per il recupero di informazioni e il rilevamento del plagio. I modelli leader (GPT-5, Claude Opus 4.6, Gemini 3.1 Pro) “allucinano” su circa il 3-8% delle domande fattuali generali ” a mondo chiuso ” nelle valutazioni controllate che si sovrappongono ai dati di addestramento, ma i tassi di “allucinazione” aumentano significativamente nei dati fuori distribuzione: per compiti di ragionamento complessi, i tassi di errore possono arrivare al 30-50%; il problema dell'”allucinazione” degli LLM non può essere risolto tramite scalatura ; è una proprietà strutturale degli LLM .

Scienziati critici (cognitivi) come Gary Marcus, Emily M. Bender, Alex Hanna, Timnit Gebru, Iris van Rooij, Olivia Guest, Erik J. Larson, Melanie Mitchell e molti altri sostengono questa tesi da sempre. A loro si sono ora uniti importanti esperti del settore come Yann LeCun (ex Meta AI), Ilya Sutskever (ex OpenAI) e Demis Hassabis, CEO di Google DeepMind. Questi esperti hanno abbandonato la strategia della Silicon Valley di raggiungere la “superintelligenza” rendendo i modelli lineari latenti (LLM) più grandi e veloci, perché non funziona e non può funzionare. Gli LLM odierni possono essere bravi nel riconoscimento e nell’individuazione di pattern, sebbene a un costo economico e ambientale enorme e sempre con “allucinazioni” incluse, ma non comprendono la causalità e non hanno un “modello del mondo” funzionante. Il percorso di scalabilità dell’industria dell’IA generativa verso “LLM superintelligenti” ha raggiunto un vicolo cieco.

Affermazione n. 2: Il boom dell’IA non è una bolla

I leader delle Big Tech sono unanimemente d’accordo: gli investimenti stratosferici nei data center per l’IA stanno costruendo l’infrastruttura (informatica) necessaria per un futuro di abbondanza. Questa infrastruttura ospiterà gli algoritmi di machine learning che (secondo le loro previsioni) cambieranno i modelli di business, trasformeranno il mondo del lavoro, accelereranno la ricerca scientifica, aumenteranno la produttività del lavoro e contribuiranno a una crescita economica più rapida. Questi investimenti colossali daranno i loro frutti: i “fondamenti” dell’industria dell’IA sono solidi. Non c’è da preoccuparsi troppo degli accordi circolari tra Nvidia, Oracle, i laboratori di IA, le aziende di neocloud e le piattaforme delle Big Tech: non si tratta certo di un castello di carte! Non c’è nemmeno bisogno di preoccuparsi della lenta corsa ai fondi di credito privato “ombra” che sono fortemente coinvolti nelle aziende di software e nell’ecosistema dei data center per l’IA. Cosa potrebbe mai andare storto, visto quanto saranno trasformativi i modelli di apprendimento automatico?

Avviso della teiera n. 2: Mi dispiace, ma il boom dell’IA è una bolla

Molte cose potrebbero andare storte, soprattutto se i LLM si rivelassero meno trasformativi di quanto promesso. A ciò si aggiunge il fatto che l’economia statunitense sta affrontando venti contrari di stagflazione, principalmente a causa dello shock sui prezzi dell’energia provocato dalla guerra di Trump contro l’Iran e dalla chiusura dello Stretto di Hormuz; i tassi di interesse probabilmente rimarranno alti e potrebbero persino aumentare, mentre i timori di recessione crescono rapidamente. La chiusura dello Stretto di Hormuz sta interrompendo le vitali catene di approvvigionamento globali di chip e componenti per computer, essenziali per l’industria statunitense dell’IA, e sta anche comprimendo gli indispensabili flussi di finanziamento provenienti dai fondi sovrani del Golfo. I laboratori di IA si trovano ad affrontare ulteriori tensioni finanziarie, perché il credito privato si sta prosciugando. I fondi di credito privato fortemente esposti ai data center e alle aziende di software per l’IA sono in difficoltà e faticano a fermare una corsa agli sportelli, con i clienti che si affrettano a ritirare i propri investimenti. “Sembra proprio di essere di nuovo in piena crisi”, ha affermato Lloyd Blankfein , ex CEO di Goldman Sachs. «Non sento la tempesta, ma i cavalli cominciano a nitrire nel recinto», ha detto, aggiungendo in tono minaccioso: «Ci stiamo avvicinando alla fine delle fasi finali di questo ciclo e presto dovremo fare i conti con la realtà».

Il motivo principale per cui il ciclo di sovrainvestimento nell’IA non è sostenibile è che nessuna delle aziende del settore ha un percorso praticabile verso la redditività. Il problema è semplice, ma irrisolvibile. I laboratori di IA si trovano ad affrontare costi di addestramento crescenti, costi di inferenza in aumento e costi aggiuntivi derivanti da controversie legali. Hanno urgente bisogno di una crescita dei ricavi. Per attrarre utenti e conquistare quote di mercato, i laboratori di IA hanno offerto servizi LLM gratuitamente o a tariffe mensili fisse, ad esempio 20 dollari al mese per gli utenti non professionisti o 200 dollari al mese per programmatori e altri utenti professionali. Queste tariffe non coprono nemmeno i costi operativi (di inferenza), perché gli utenti sono incentivati a sfruttare al massimo i modelli di IA, visti i costi fissi che pagano. Questo è uno dei motivi principali per cui i laboratori LLM continuano a registrare perdite. Le aziende di IA non possono semplicemente aumentare le tariffe di abbonamento, perché si trovano a fronteggiare una forte concorrenza (di prezzo) da parte dei rivali cinesi che offrono prestazioni pressoché identiche a costi inferiori. Di conseguenza, le aziende di IA stanno ricorrendo all’introduzione di limiti di utilizzo dei servizi LLM nelle ore di punta.

L’alternativa all’addebito di una tariffa fissa è quella di addebitare agli utenti il costo effettivo del token (o il costo equivalente per l’utente dell’API). Tuttavia, in un sistema a consumo, gli utenti sarebbero costretti ad acquistare un servizio LLM senza conoscerne il prezzo; il motivo è che non c’è modo di prevedere quanti token consumerà una determinata richiesta . Ogni volta che l’LLM commette un errore o si blocca per qualche minuto, consumando sempre più token, l’utente deve pagare, e questo disincentiverà l’utilizzo dell’LLM. La maggior parte degli utenti, soprattutto i programmatori, non è assolutamente preparata al costo del consumo effettivo di token. Un sistema a consumo difficilmente risolverà quindi il problema e i laboratori di intelligenza artificiale rimarranno bloccati in un modello di business non sostenibile.

Affermazione n. 3: L’intelligenza artificiale porterà a un’apocalisse dei posti di lavoro per i colletti bianchi

L’IA agentiva porterà a un “bagno di sangue per i colletti bianchi” (Dario Amodei); gli agenti IA possono sostituire ogni lavoro da colletto bianco in 18 mesi (Mustafa Suleyman, CEO di Microsoft per l’IA); intere categorie di lavoro potrebbero essere spazzate via dall’IA (Sam Altman); dal 20% al 50% dei 70 milioni di impiegati negli Stati Uniti perderà il lavoro, in un “grande sventramento” dei lavoratori d’ufficio (Andrew Yang); l’IA porterà a un'”apocalisse” per i professionisti altamente istruiti, con una formazione umanistica, spesso donne, appartenenti alla classe dei diplomati di orientamento democratico, poiché gli strumenti di IA li stanno privando del loro potere economico e trasferendo tale potere agli uomini della classe operaia di destra (Alex Karp, CEO di Palantir).

Avviso della teiera n. 3: l’intelligenza artificiale non distruggerà la maggior parte dei lavori d’ufficio, ma li trasformerà

Lo scopo di queste bizzarre previsioni è quello di instillare nei lavoratori la paura dell’IA, segnalando al contempo agli investitori finanziari l’inedito potere trasformativo dei modelli di business basati sull’intelligenza artificiale (IA). Ma le previsioni di un'”apocalisse del lavoro causata dall’IA” suscitano un travolgente senso di déjà vu. Non molto tempo fa, Carl Benedikt Frey e Michael Osborne (2013) conclusero che quasi il 47% dei posti di lavoro negli Stati Uniti presentava una probabilità superiore al 70% di “potenzialmente automatizzabile in un arco di tempo imprecisato, forse un decennio o due”. Tuttavia, l’analisi di dati dettagliati sull’occupazione per oltre 600 professioni (nel periodo 2013-2024) dimostra che le previsioni di Frey e Osborne sulla distruzione dei posti di lavoro manuali si sono rivelate ampiamente errate.

Perché l’era dell’IA dovrebbe essere diversa? In effetti, la maggior parte delle professioni negli Stati Uniti se la passa bene, non minacciata dalla rivoluzione dell’IA. Nuovi dati sull’esposizione all’IA per professione, pubblicati da Anthropic, suggeriscono che le mansioni associate a circa il 40% delle professioni statunitensi non compaiono nei dati sull’utilizzo dell’IA a livelli significativi. L’esposizione all’IA è da bassa a moderata in un altro 29% delle professioni (svolgendo fino al 15% delle mansioni associate a questi lavori). Complessivamente, più di due terzi delle professioni statunitensi sono, per ora, completamente immuni o solo moderatamente esposte alla nuova tecnologia.

Un’analisi più approfondita del terzo delle professioni statunitensi con un’elevata esposizione all’IA suggerisce che gli strumenti di IA non sostituiranno la maggior parte dei posti di lavoro, ma li trasformeranno . L’indicatore di esposizione all’IA di Anthropic non ha alcun potere predittivo sulla crescita occupazionale prevista per le diverse professioni, basandosi sulle proiezioni del BLS (Bureau of Labor Statistics) per il prossimo decennio. Per esempio, nessun radiologo ha perso il lavoro a causa dell’IA. L’occupazione per i biologi strutturali, finora, non è diminuita a causa del ripiegamento proteico basato sull’IA. Ciò che è accaduto è che i biologi strutturali ora dedicano meno tempo alla determinazione delle strutture proteiche e più tempo alla loro interpretazione, validazione e utilizzo. Di fatto, gli strumenti di IA (come AlphaFold) hanno creato nuovi posti di lavoro per biologi strutturali computazionali, esperti di bioinformatica, microscopisti crioelettronici e biologi farmaceutici.

Affermazione n. 4: L’intelligenza artificiale aumenterà la produttività del lavoro

Questa affermazione è un corollario dell’affermazione n. 3. La profezia della distruzione di posti di lavoro causata dagli investimenti nell’IA presuppone che l’utilizzo di strumenti di IA aggiuntiva aumenterà significativamente la produttività del lavoro, se si è disposti a credere all’iperbole secondo cui quest’ondata di automazione metterà fuori gioco il 20% o più dei 70 milioni di impiegati negli Stati Uniti. Erik Brynjolfsson e Jason Furman hanno dichiarato pubblicamente che l’IA sta già avendo un impatto misurabile sulla produttività del lavoro nel settore non agricolo degli Stati Uniti.

Avviso della teiera n. 4: L’impatto netto dell’IA sulla produttività sarà probabilmente minimo

L’indicatore di esposizione all’IA di Anthropic mostra che due terzi delle professioni statunitensi rimarranno totalmente o sostanzialmente inalterate dai nuovi strumenti di apprendimento automatico. Ciò significa che l’impatto dell’IA sulla produttività si concentrerà in un terzo delle professioni statunitensi. È quindi prevedibile che l’era dell’IA non porterà presto a un massiccio aumento della crescita aggregata della produttività. La maggior parte degli economisti concorda su questo punto. Un recente sondaggio condotto su 69 economisti, 27 professionisti del settore dell’IA e 25 esperti di politiche sull’IA conclude che la maggior parte delle previsioni economiche incondizionate sulla crescita della produttività durante la prossima era dell’IA (2025-2035) sono piuttosto vicine alle tendenze storiche. Gli economisti intervistati prevedono un modesto aumento della crescita della produttività statunitense di circa 0,2 punti percentuali nel 2030. Questo dato è simile alla stima di Alexander Arnon (2025), che scrive per il Penn Wharton Budget Model, ma più del doppio rispetto alla stima volutamente prudente (e ragionevole) di Daron Acemoglu (2025).

L’impatto complessivo stimato dell’intelligenza artificiale sulla produttività è profondamente scoraggiante. Secondo le stime di Arnon, si può calcolare che l’IA aggiungerà un totale cumulativo di 2.900 miliardi di dollari (a prezzi costanti del 2017) al percorso di crescita di base dell’economia statunitense, secondo le previsioni del Congressional Budget Office (CBO), nel periodo 2025-2035. Questi trilioni di dollari aggiuntivi sono generati da un investimento cumulativo previsto di 4.500 miliardi di dollari (a prezzi costanti del 2017) da parte dell’industria dell’IA nel periodo 2025-2035.

Riflettiamo su questi numeri. Il ritorno macroeconomico degli ingenti investimenti in intelligenza artificiale sarà molto probabilmente negativo nel prossimo decennio. Il ritorno macroeconomico degli investimenti in IA potrebbe addirittura essere inferiore, perché la percentuale di risparmio netto derivante dall’IA potrebbe essere inferiore a quanto generalmente ipotizzato. Il punto è questo: l’utilizzo di strumenti di IA non genera solo benefici, ma anche costi, e molti di questi costi vengono esternalizzati come danni collaterali e minore produttività.

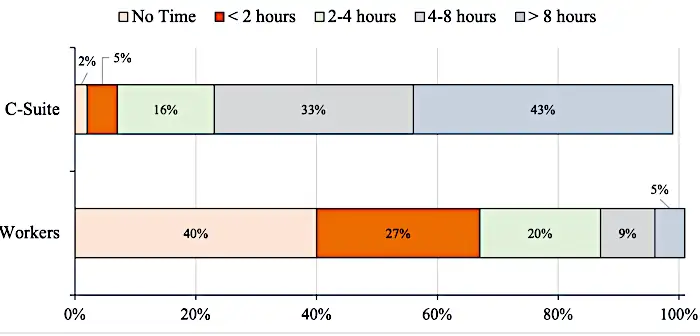

Innanzitutto, il “lavoro superfluo” generato dall’IA sta danneggiando la motivazione e la produttività dei lavoratori . I dirigenti aziendali ritengono che l’IA sia uno strumento per migliorare la produttività aziendale, ma i dipendenti raccontano una storia ben diversa . Il Wall Street Journal ha riportato i risultati di una ricerca condotta dalla società Section, che ha intervistato 5.000 impiegati di aziende con più di 1.000 dipendenti ( Figura 1 ). Oltre il 70% dei dirigenti aziendali intervistati si è dichiarato “entusiasta” dell’IA e il 43% ha affermato che questi strumenti hanno fatto risparmiare loro più di 8 ore di lavoro a settimana. Ma i lavoratori non dirigenziali hanno avuto un’opinione molto diversa sull’IA. Quasi il 70% di questo gruppo ha affermato che l’IA li faceva sentire ” ansiosi o sopraffatti ” e il 40% ha dichiarato che gli strumenti non hanno fatto risparmiare loro tempo; il 27% dei lavoratori non supervisori ha risparmiato meno di 2 ore a settimana utilizzando strumenti di IA. Molti dipendenti riferiscono che il tempo risparmiato grazie all’IA viene compensato dalla necessità di correggere l’output dell’IA o di affrontare confusione e rilavorazioni. 4 dipendenti su 10 non avrebbero problemi a non utilizzare mai più l’IA. Occuparsi degli errori e delle imperfezioni nel lavoro è demotivante e riduce la produttività dei dipendenti. Inoltre, genera sfiducia all’interno dell’organizzazione: i colleghi usano l’IA per produrre un report e tu devi fare straordinari per correggere gli errori, colmare le lacune e rimuovere i riferimenti inesistenti.

Figura 1 Quanto tempo pensi di risparmiare ogni settimana utilizzando l’IA (percentuali) Fonte: Ellis (2026). Nota: i totali potrebbero non sommare al 100% a causa degli arrotondamenti.

Un sondaggio condotto dalla società di software WalkMe su 3750 dirigenti e dipendenti ha rilevato che, sebbene l’81% dei dirigenti ritenga che i propri strumenti di intelligenza artificiale abbiano “migliorato significativamente la produttività”, i loro dipendenti in realtà sprecano otto ore a settimana a correggere gli errori causati dall’IA, l’equivalente di 51 giornate lavorative all’anno. L’IA non sta mantenendo le promesse.

L’intelligenza artificiale sta causando molti altri danni collaterali. L’eccesso di dati generati dall’IA sta intasando i tribunali statunitensi , provocando un enorme spreco di tempo e denaro. I crawler web basati sull’IA stanno setacciando il web alla ricerca di contenuti sempre più numerosi da alimentare, sovraccaricando i siti web di interesse pubblico con picchi di traffico che possono raggiungere livelli dieci o addirittura venti volte superiori alla norma in pochi minuti, causando degrado delle prestazioni, interruzioni del servizio e aumento dei costi operativi. È stato riscontrato che la dipendenza da strumenti di intelligenza artificiale generativa porta a un’erosione del ragionamento analitico e del pensiero critico , nonché a un declino nel mantenimento delle competenze e nella valutazione dei risultati.Nel settore sanitario, è stato riscontrato che la dipendenza dall’IA riduce il ragionamento diagnostico, il giudizio clinico, la capacità di memorizzazione delle conoscenze tacite e indebolisce la sensibilità etica e il giudizio morale ( Ferdman 2025 ). La scienza è sommersa da un eccesso di IA. Gli strumenti di IA stessi stanno creando nuove minacce alla sicurezza informatica che potrebbero danneggiare i profitti delle aziende.

L’utilizzo di assistenti di programmazione basati sull’IA compromette la qualità del codice. GitClear ha analizzato 211 milioni di righe di codice di importanti aziende tecnologiche e ha riscontrato una crescita quadrupla del codice copiato e incollato, il che significa che gli strumenti di IA duplicano la logica anziché generarne di nuova; un calo della longevità del codice; e una diminuzione del refactoring, pratica essenziale per la manutenibilità a lungo termine del codice. Uno studio recente ha testato 18 agenti di programmazione basati sull’IA sulla manutenzione di 100 codebase reali, per una durata di 233 giorni ciascuna. Gli agenti di IA possono produrre codice che supera i test di benchmark su attività di ingegneria del software statiche una tantum, come la correzione statica dei bug, ma il 75% dei modelli testati, tra cui Cursor, Claude Code e Devin, compromette il codice precedentemente funzionante durante le attività di manutenzione a lungo termine. Il codice generato dall’IA privilegia soluzioni a breve termine basate sul copia-incolla rispetto a una progettazione a lungo termine e ignora la coerenza architetturale. Il risultato è un software che funziona oggi ma che diventa problematico da modificare domani.

Forse la conseguenza più pericolosa è che le aziende hanno ridotto drasticamente le assunzioni di personale entry-level, credendo che l’IA potesse gestire i compiti di livello base. Ma gli sviluppatori junior non si limitano a scrivere codice, bensì si trasformano in futuri ingegneri senior . Quando questo flusso di talenti si interrompe, l’intero settore del software ne risentirà. Tra circa cinque o sette anni si verificherà una carenza di sviluppatori senior che sarà davvero catastrofica. E sarà interamente autoinflitta, perché non sono gli strumenti di IA a sostituire gli ingegneri junior, bensì una cattiva gestione aziendale.

Affermazione n. 5: L’IA sta già distruggendo posti di lavoro nei settori con un’elevata esposizione all’IA

Una nuova ricerca degli economisti di Goldman Sachs afferma che l’intelligenza artificiale sta già avendo un impatto negativo misurabile sul mercato del lavoro statunitense, con una perdita netta di circa 16.000 posti di lavoro al mese nell’ultimo anno, colpendo soprattutto la Generazione Z e i lavoratori alle prime armi. Le offerte di lavoro per sviluppatori software sono in forte calo rispetto al picco massimo e rimangono ben al di sotto dei livelli pre-pandemia. L’occupazione è diminuita dalla fine del 2022 nel 10% delle professioni più esposte all’IA , nonostante l’occupazione totale negli Stati Uniti sia aumentata. Il calo dell’occupazione nei settori esposti all’IA è particolarmente pronunciato per i giovani sotto i 25 anni. Tale calo non è dovuto a licenziamenti, bensì a un basso tasso di assunzione per i giovani che entrano nel mercato del lavoro.

Avviso della teiera n. 5: Una rondine non fa primavera

È prematuro attribuire esclusivamente all’intelligenza artificiale il basso tasso di assunzione di neolaureati e altri lavoratori alle prime armi. Il contesto macroeconomico è fondamentale. Nel marzo 2020, la Federal Reserve ha tagliato i tassi di interesse quasi a zero e li ha mantenuti a quel livello per due anni. Non essendoci costi per prendere denaro in prestito, le aziende hanno speso di conseguenza. Le grandi aziende tecnologiche, nel loro complesso, hanno assunto milioni di dipendenti. Questo periodo è stato seguito dal ciclo di inasprimento monetario più rapido degli ultimi 40 anni, che ha aumentato il costo del capitale per le imprese. I bassi tassi di assunzione e i licenziamenti nel settore tecnologico rappresentano quindi un ” ribaltamento dell’eccesso di assunzioni verificatosi negli ultimi cinque anni ” (in risposta all’inasprimento monetario) piuttosto che una sostituzione da parte dell’intelligenza artificiale.

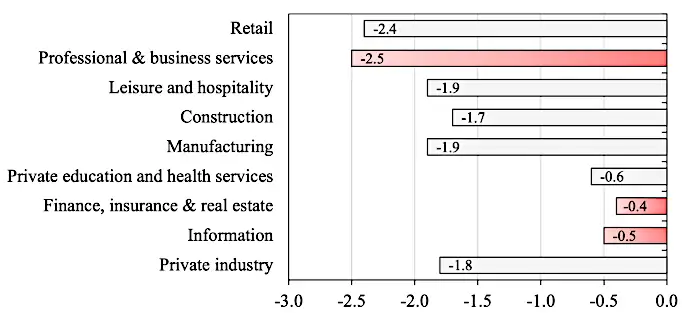

I tassi di assunzione nel settore privato, che hanno raggiunto il picco nel novembre 2021, sono diminuiti in tutti i settori statunitensi (Figura 2), non solo in quelli esposti all’IA (ad esempio, “Informazione”, “Finanza, assicurazioni e immobiliare” e “Servizi professionali e alle imprese”). Quasi il 60% dei responsabili delle assunzioni statunitensi intervistati da Resume.org (2026) ha affermato di enfatizzare il ruolo dell’IA nella riduzione delle assunzioni o nei tagli al personale, perché ciò è visto più favorevolmente rispetto all’enfasi sulla vera ragione (ovvero, i vincoli finanziari). Uno studio della Federal Reserve del marzo 2026 ha analizzato i dati di oltre un milione di aziende e non ha trovato alcuna prova che la riduzione delle offerte di lavoro sia dovuta all’adozione dell’IA. Persino Sam Altman ha denunciato il “lavaggio del cervello” aziendale basato sull’IA per mascherare i licenziamenti per motivi finanziari.

Figura 2 Tassi di assunzione nei principali settori (variazione percentuale durante novembre 2021-febbraio 2026 Fonte: database FRED, basato sui dati BLS del Job Opening and Labor Turnover Survey (JOLTS). Note: Il tasso di assunzione è definito come il numero di lavoratori neoassunti in percentuale rispetto ai lavoratori già occupati in un mese. Le barre rosse indicano i settori con la maggiore esposizione all’IA.

Affermazione n. 6: L’IA eliminerà in gran parte i lavori inutili e ne creerà di migliori

Negli Stati Uniti, un lavoratore su cinque afferma che il proprio lavoro non apporta un contributo significativo al mondo . Si tratta generalmente di lavori d’ufficio, soprattutto posizioni di assistente o di gestione, il cui status è spesso definito dal numero di persone che dipendono da questi manager piuttosto che dal lavoro effettivamente svolto. Il compianto David Graeber definiva questi lavori “colletti bianchi”, che persino chi li svolge considera privi di significato, “lavori inutili”. Si sostiene che i master in giurisprudenza (LLM) possano automatizzare compiti banali e ruoli alienanti che costituiscono questi “lavori inutili”. Gli strumenti di intelligenza artificiale possono essere utilizzati per imitare la componente performativa del lavoro d’ufficio: redigere e-mail, creare aggiornamenti di stato, riformulare report, perfezionare presentazioni, trascrivere e riassumere riunioni che, a ben vedere, non erano nemmeno necessarie. Sam Altman ha avanzato l’idea che il lavoro che potrebbe essere trasformato o eliminato a breve dall’intelligenza artificiale non sia “vero lavoro”.

Una volta eliminati questi inutili e insoddisfacenti lavori d’ufficio, i lavoratori rimanenti saranno “messi in condizione” di concentrarsi su un lavoro significativo e creativo.

Avviso della teiera n. 6: No, l’IA creerà un sacco di lavori inutili

L’uso dell’IA creerà nuovi posti di lavoro, perché gli strumenti di IA devono essere monitorati, supervisionati, controllati e gestiti, dato che generano errori critici, errori di sintesi, errori scientifici, errori legali, errori medici, errori di marketing, errori sui social media, nuovi rischi per la sicurezza informatica, codice fragile e un debito tecnico crescente che potrebbe mandare in rovina aziende e istituzioni se riguarda attività critiche. Di conseguenza, l’adozione dell’IA creerà uno strato di ingegneri e manager di supervisione pronti a intervenire, che controlleranno i “colleghi IA” in nuovi lavori inutili, correggendo gli errori, mantenendo il codice, proteggendo l’integrità dei sistemi digitali, identificando “allucinazioni” e fake news e, più in generale, combattendo la “infiltrazione” di IA nel mondo del lavoro, in internet e nella società.

Le aziende istituiranno anche comitati etici sull’IA per “lavare” o “controllare” qualsiasi modello venga implementato, ed emergeranno nuove figure di middle management per spiegare l’IA e i suoi risultati a dirigenti ingenui e ignoranti che non li comprendono. Ci saranno comitati e task force “di basso livello” per l’allineamento della strategia dell’IA, direttori senior per l’integrità tempestiva e vicepresidenti per la sicurezza informatica dell’IA , e gli uffici legali e le figure professionali legali cresceranno esponenzialmente, perché le aziende faranno di tutto per sfuggire alla responsabilità per tutti gli errori e i danni che i loro strumenti di IA produrranno. Il risultato non sarà una diminuzione dei posti di lavoro, ma posti di lavoro diversi: tutti posti di “spese generali”, la cui funzione primaria non è la produzione, ma l’assicurazione e la rassicurazione: ” la rassicurazione che la gerarchia rimanga intatta, che gli esseri umani restino ‘nel ciclo’ e che qualcuno, da qualche parte, sia ancora nominalmente responsabile “.

Oltre a tutto ciò, il taylorismo guidato dall’IA creerà ulteriori posti di lavoro superflui nella sorveglianza dei dipendenti. Dopotutto, la “legge ferrea” della tecnologia di sorveglianza è che se può essere utilizzata, verrà utilizzata. Con molti più strumenti di monitoraggio, i datori di lavoro tracciano gli schermi dei PC, registrano i tasti premuti, analizzano le comunicazioni interne e persino scansionano i volti dei dipendenti alla ricerca di segni di stanchezza. I sistemi basati sull’IA monitorano il tono delle comunicazioni interne, tracciano la frequenza dei messaggi e registrano l’utilizzo delle applicazioni su diverse piattaforme digitali. Il completamento delle attività, la navigazione web e i tempi di risposta vengono filtrati tramite algoritmi per determinare i punteggi di produttività individuali dei lavoratori, che vengono utilizzati per decidere su promozioni e (bonus) retribuzioni. Gli strumenti di IA vengono impiegati per condurre controlli automatizzati sui precedenti (di dipendenti e candidati) che raccolgono, con totale disprezzo per la privacy e la decenza umana, registri pubblici, dati finanziari e attività sui social media per valutare il “rischio” per il datore di lavoro. Il risultato è un ambiente di lavoro distopico, privo di privacy e fiducia. La sorveglianza costante da parte di agenti di sorveglianza crea un effetto dissuasivo e mina la produttività , soprattutto in ambienti collaborativi e creativi dove la sicurezza psicologica, la fiducia e la libertà sono fondamentali per l’innovazione.

Affermazione n. 7: Il mythos di Anthropic è troppo pericoloso per essere reso pubblico

Mythos è un nuovo modello di intelligenza artificiale sviluppato da Anthropic, che si vanta di essere così potente da aver individuato migliaia di vulnerabilità in sistemi operativi e browser web esistenti. Inaspettatamente, la versione di anteprima di Mythos ha anche sviluppato un exploit a più fasi, di media complessità, per ottenere l’accesso a Internet, cosa che, secondo la programmazione, non sarebbe in grado di fare. Si afferma che Mythos sia il modello di intelligenza artificiale “più etico” in assoluto, con un livello di capacità di programmazione tale da “superare tutti, tranne gli esseri umani più esperti, nell’individuazione e nello sfruttamento delle vulnerabilità del software”. Presentandosi come l’unica azienda al mondo impegnata nell’IA responsabile, e dando priorità alla gestione responsabile dell’intelligenza artificiale, Anthropic ha deciso di non rilasciare Mythos al pubblico, poiché ciò rappresenterebbe una grave minaccia per la sicurezza informatica di Internet. Questa posizione etica, tuttavia, ha un prezzo. Anthropic ha deciso di lanciare il progetto di difesa informatica Glasswing, che offre il modello Mythos in esclusiva a clienti facoltosi come Amazon, Apple, Google, Microsoft, Nvidia, CrowdStrike, JPMorgan Chase, Cisco, Broadcom, Palo Alto Networks e la Linux Foundation, in cambio di denaro (4 milioni di dollari in donazioni dirette e 100 milioni di dollari in crediti d’uso di Claude).

Avviso della teiera n. 7: Non si tratta di Mythos; i deboli sistemi di sicurezza informatica del mondo reale devono essere urgentemente rafforzati

L’arrivo del modello Mythos dimostra che i sistemi di sicurezza informatica reali sono deboli e vulnerabili, e che anche gli attaccanti meno esperti possono essere efficaci utilizzando strumenti di intelligenza artificiale su larga scala. Tuttavia, Anthropic sta abilmente esagerando le capacità di Mythos. In primo luogo, i tentativi di hacking andati a buon fine di Mythos Preview hanno preso di mira la shell JavaScript di Firefox, un ambiente di debug semplificato che non include le reali difese di sicurezza del browser. Il browser Firefox reale ha più livelli di difesa contro il codice dannoso; Anthropic si è concentrata su un solo livello . Per focalizzare l’analisi, a Mythos sono stati forniti ulteriori prompt di sistema. Tutto ciò indica che esiste un divario significativo tra il test e le reali difese che un attaccante si troverebbe effettivamente ad affrontare. In secondo luogo, Mythos Preview ha trovato un bug, ora corretto, che permetteva di mandare in crash da remoto OpenBSD , un sistema operativo open source utilizzato in infrastrutture critiche come i firewall. AISLE, una startup di sicurezza informatica basata sull’IA, ha testato otto modelli lineari di apprendimento (LLM) economici, di piccole dimensioni e open-weight per verificare se fossero in grado di trovare il bug, presente da 27 anni. Ogni singolo modello testato l’ha individuato , incluso uno che costa 0,11 dollari per milione di token, una frazione del costo dei token di Anthropic. In un’attività di base di ragionamento sulla sicurezza, i modelli open-weight economici e di piccole dimensioni superano la maggior parte dei modelli di frontiera più costosi di tutti i principali laboratori, incluso Anthropic. La chiave per un’efficace capacità di sicurezza informatica basata sull’IA è il sistema per individuare le vulnerabilità, non la dimensione del modello di IA.

Affermazione n. 8: Dobbiamo orientare la situazione verso un’IA “a favore dei lavoratori”

Gli economisti del MIT Daron Acemoglu, David Autor e Simon Johnson (2026) auspicano che ciò accada. Il trio del MIT distingue tra IA “cattiva” e “buona” (a favore dei lavoratori) e desidera che il governo (Trump?) spinga le politiche e le normative sull’IA in una direzione inequivocabilmente “a favore dei lavoratori”, promuovendo tecnologie che valorizzino le competenze e l’esperienza umana creando nuove mansioni. Per raggiungere questo obiettivo, propongono una serie di interventi politici neoliberisti, tra cui la creazione di competenze sull’IA all’interno della pubblica amministrazione, l’incentivazione della concorrenza, la possibilità per i lavoratori di “avere voce” (in cosa esattamente?), la riforma fiscale, la prevenzione del furto di competenze e l’abolizione delle licenze professionali. Non propongono riforme più profonde del capitalismo azionario e della finanza.

Avviso della teiera n. 8: l’IA commerciale non sarà a favore dei lavoratori, mi dispiace

Le richieste di un’intelligenza artificiale “a favore dei lavoratori” ignorano scomode verità fondamentali: la spinta intrinseca all’automazione, allo sfruttamento e al controllo dei lavoratori, radicata nel capitalismo (azionario), il crollo storico dei sindacati, l’ascesa del taylorismo elettronico, la cattura della regolamentazione governativa da parte delle grandi aziende tecnologiche e le pressioni della concorrenza globale per ridurre i costi del lavoro. Le facili richieste di un’intelligenza artificiale “a favore dei lavoratori” non tengono conto della realtà concreta, in cui Jeff Bezos sta usando gli strumenti di sorveglianza algoritmica di Amazon per impedire ai lavoratori di organizzarsi, reprimendo i movimenti sindacali all’interno dei suoi magazzini; Elon Musk pretende che i suoi dipendenti lavorino lunghe ore di straordinario senza essere pagati né dormire, mentre lui se ne sta in giro a twittare; Sam Altman dà priorità alla “crescita” rispetto alle “preoccupazioni per la sicurezza” , stringendo alleanze con ricchi dittatori del Golfo non noti per il loro rispetto dei diritti umani; e Mark Zuckerberg adotta un atteggiamento ostile nei confronti dei suoi stessi dipendenti, reprime la libertà di parola all’interno della sua azienda, impedisce il coinvolgimento dei lavoratori nei processi decisionali e abolisce tutte le iniziative a favore della diversità.

Le aziende usano l’IA come minaccia per disciplinare i lavoratori o licenziarli, ma con lo scopo di riassumerli come lavoratori a progetto o di trovare qualcun altro nella catena di approvvigionamento che svolga quel lavoro al loro posto. ” Il tuo capo vuole usare i dati di sorveglianza per tagliarti lo stipendio ” riassume bene la situazione. Ma questa agghiacciante illustrazione della discriminazione salariale basata sulla sorveglianza tramite IA (comune negli Stati Uniti nei settori sanitario, del servizio clienti, della logistica e della vendita al dettaglio), fornita da Cory Doctorow, ribadisce il concetto:

“La discriminazione salariale algoritmica si basa su fonti di dati esterne per stabilire il prezzo del lavoro. Questa è la situazione degli infermieri a contratto, le cui tradizionali agenzie di collocamento sono state sostituite da app nazionali che si presentano come “Uber per gli infermieri”. Queste app utilizzano dati di sorveglianza commerciali provenienti dal settore non regolamentato dei data broker per verificare l’ammontare dei debiti sulle carte di credito di un infermiere e se tali debiti sono insoluti, al fine di stabilire la retribuzione: maggiore è il debito e più grave è la situazione debitoria, minore sarà la retribuzione offerta.”

Avere un saldo negativo sulla carta di credito, richiedere un prestito a breve termine o discutere dei propri debiti su WhatsApp o Instagram può portare a una riduzione dello stipendio. “L’intelligenza artificiale non vi ruberà il lavoro, ma probabilmente lo renderà peggiore”, afferma Alex Hanna , direttore della ricerca presso il Distributed AI Research Institute.

Svegliati: intelligenza artificiale senza ketamina

L’attuale comprensione dell’impatto economico dell’IA è errata: l’IA non porterà alla “superintelligenza”, alla distruzione di massa di posti di lavoro, a una disoccupazione tecnologica senza precedenti e a una recessione, né a giganteschi aumenti (aggregati) della produttività del lavoro e a un’accelerazione senza precedenti del progresso tecnologico e della crescita economica. L’impatto a livello aggregato dell’IA sarà piuttosto banale: alcune professioni scompariranno a causa dell’automazione; i lavori esistenti saranno rimodellati dall’IA e nasceranno nuove professioni, mansioni e ruoli per supervisionare e gestire gli strumenti di IA; molti di questi nuovi lavori saranno lavori inutili; tuttavia, la maggior parte delle professioni rimarrà al riparo; la crescita aggregata della produttività del lavoro potrebbe aumentare leggermente (perché gli strumenti di IA potenziano il lavoro), ma allo stesso tempo i costosi danni collaterali dell’IA cresceranno esponenzialmente nel tempo e rallenteranno la crescita della produttività. Maggiore sarà la quantità di scarti generati dall’IA, maggiore sarà il lavoro necessario per ripulire il disordine e maggiore sarà la probabilità che non saremo in grado di vedere l’era dell’IA nelle statistiche sulla produttività. Considerato tutto quanto sopra, l’attuale ciclo di sovrainvestimenti nell’IA non è sostenibile.

Add comment